基于python的知识库的问答seq2seq模型代码实现

”python 开发语言 seq2seq模型代码实现“ 的搜索结果

基于知识库的问答:seq2seq模型实践

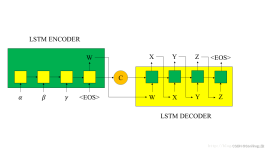

1.1. Seq2Seq模型概述 Seq2Seq (Sequence-to-Sequence) 模型是一种深度学习架构,用于处理序列到序列的学习任务。它由编码器和解码器两部分组成,编码器将输入序列转换为固定长度的向量表示,解码器则根据该向量表示...

这里写自定义目录标题seq2seq模型介绍Keras实现seq2seq模型Encoder部分Decoder部分Encoder和Decoder合并模型详细结构seq2seq模型训练 本文主要是利用keras框架记录简单实现seq2seq模型的过程,seq2seq的应用主要有...

2. 代码实现 代码一:为模型创建输入 代码二:构建模型 代码三:检验模型性能 1. 案例介绍 为便于讲解seq2seq模型用例,我们采用一篇研究论文中所使用的注释预料库的文本内容。 论文:《Learning Phrase ...

seq2seq模型架构,包括两部分分别是encoder(编码器)和decoder(解码器),编码器和解码器的内部实现都使用了GRU模型,这里它要完成的是一个中文到英文的翻译:欢迎来北京--> welcome to BeiJing. 编码器首先处理...

本文给大家带来的时间序列模型是Seq2Seq,这个概念相信大家都不陌生了,网上的讲解已经满天飞了,...Seq2Seq模型是一种处理序列数据的深度学习模型,广泛用于机器翻译、语音识别和文本摘要等任务(也能用于时间序列)。

pycorrector依据语言模型检测错别字位置,通过拼音音似特征、笔画五笔编辑距离特征及语言模型困惑度特征纠正错别字。 Guide Question 中文文本纠错任务,常见错误类型包括: 谐音字词,如 配副眼睛-配副眼镜 混淆音...

目录 带有注意力机制的编码器-解码器(Encoder-Decoder with Attention) 一个测试注意力机制的问题(Test Problem for Attention) 没有注意力机制的编码-解码(Encoder-Decoder Without Attention) ...

第N5周:seq2seq详解

随着人工智能和机器学习技术的不断发展,Seq2Seq模型在自然语言处理领域取得了巨大成功,在机器翻译、对话系统等应用中发挥了重要作用。近年来,Seq2Seq模型也被应用于代码生成领域,取得了令人鼓舞的进展。代码生成是...

Seq2Seq模型在自然语言处理领域有着广泛的应用。例如在机器翻译任务中,可以将源语言序列作为输入,目标语言序列作为输出,通过训练模型实现跨语言翻译。此外,Seq2Seq模型还可以用于对话系统中的问答生成、文本摘要...

通过使用Seq2Seq模型,我们可以从自然语言描述中生成对应的代码,并在开发中提高效率。该函数将自然语言描述作为输入,从编码器模型中获取向量表示,然后使用解码器模型生成对应的Python代码。在这个任务中,我们将...

Tacotron2 (Text-To-Speech),是 Google 的开源语音合成神经网络模型,由两部分...本文将使用 Python 的 TensorFlow 和 PyTorch 框架对 Tacotron2 模型进行实践并展示如何使用 Python 实现基于 Tacotron2 的语音合成。

用Seq2Seq模型开发翻译系统时,假设输入一句法语,输出英文。在Decoder输出部分,选择不同的单词,输出(翻译)的结果也会不同。 这里用下图来举例说明: 一个法语句子,被Seq2Seq模型翻译为不同的4句英文,我们该...

用python做一个简单的深度学习语言模型

因此,我们将从零开始构建一个LSTM神经网络,并用Python语言实践其训练和应用。本文将以最基本的案例——数字序列生成为例,一步步地教授读者如何搭建一个LSTM神经网络,并用该模型来生成数字序列。

Python 基于pytorch从头写GPT模型;实现gpt实战;详细解释GPT模型架构和源代码;GPT源码解读与实战

下面是一个简单的 HMM 模型的 Python 代码示例,它使用了经典的隐马尔可夫模型(HMM)用于自然语言处理(NLP)的例子,即标记噪声词的词性标注任务。在这个例子中,我们假设已经知道了 HMM 的转移概率矩阵、发射概率矩阵...

在过去的几年里,文本生成技术取得了显著的进展,从简单的序列到序列(seq2seq)模型开始,逐渐发展到现在的GPT-2和GPT-3。这些模型不仅能够生成高质量的文本,还能处理复杂的语言任务,如机器翻译、文本摘要和对话...

目前,大模型十分活跃,openai公司呈现...然而,多模态模型大多以CLIP所提方法或思路实现多模态融合。为此,本文将重新回顾CLIP论文相关理论,也重点梳理其源码,并附其代码供读者参考(本文会涉及VIT与BERT代码解读)。

以上就是我们微调llama2的完整过程,这里面的一个最重要的步骤其实是提示的生成,一个好的提示对于模型的性能也是非常有帮助的。[3] 本文使用的数据集 ...

开启想象翅膀:轻松实现文本生成模型的创作应用,支持LLaMA、ChatGLM、UDA、GPT2、Seq2Seq、BART、T5、SongNet等模型,开箱即用

翻译 | 和中华校对 | 申利彬来源 | 数据派THU(ID:DatapiTHU)本文介绍了如何利用seq2seq来建立一个文本摘要模型,以及其中的注意力机制。并利用Ke...

Seq2Seq模型是NLP中的一个经典模型,最初由Google开发,并用于机器翻译。它基于RNN网络模型构建,能够支持且不限于的应用包括:语言翻译、人机对话、内容生成等。

推荐文章

- Android 编译so文件 MP4V2_android下编译mp4v2-程序员宅基地

- 通讯录Contact_02_contact文件内容-程序员宅基地

- Qt笔记(四十二)之QZXing的编译 配置 使用_qzxingfilterrunnable error:-程序员宅基地

- 关于画图软件Dia打开程序始终为英文界面的问题-程序员宅基地

- OpenCV从入门到精通实战(二)——文档OCR识别(tesseract)-程序员宅基地

- 详解avcodec_receive_packet 11_avcodec_receive_packet eagain-程序员宅基地

- OpenGL SuperBible 7th源码编译记录_superbible7-media github-程序员宅基地

- Wireshark简单使用-程序员宅基地

- MXNet 粗糙的使用指南_iou loss mxnet-程序员宅基地

- iOS对ipa包进行代码混淆《二》 ---代码混淆_ipa包混淆-程序员宅基地